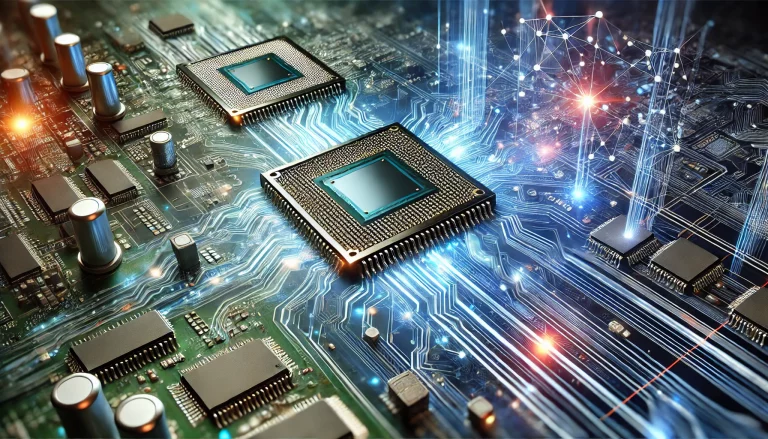

2025年12月3日、米エヌビディアは最新型AIサーバーにより複数の新型モデルの性能が最大10倍向上したとするデータを公表した。

新型サーバーで主要AIモデルの推論が大幅高速化

エヌビディアは最先端半導体72個で構成される最新AIサーバーの性能を検証し、前世代との比較で推論処理が大きく向上したと明らかにした。

具体的には、ムーンショットの「Kimi K2 Thinking」が、前世代のエヌビディア製サーバーと比べて10倍高まったという。両モデルは効率性と軽量性を重視したアーキテクチャが特徴で、今回の結果はその適合性を示すものとなった。

今回エヌビディアが重視したのは、複数の専門家AIに処理を分配するMoE(混合エキスパートモデル)だ。この手法は、問いを複数の要素に分割し、各エキスパートに割り当てることで計算効率を高める構造を持つ。

ディープシークが今年初め、少数のエヌビディア製半導体で高性能なオープンソースモデルを提示したことが転機となり、技術の注目度が急上昇した。

現在はオープンAIやムーンショットAIなど主要プレイヤーがMoEを採用している。

性能10倍が示す恩恵とリスク 市場再編の行方を読む

今回の性能向上は企業のAI導入ハードルを下げる追い風として作用すると見られる。

MoEは計算負荷を細かく分散させる特性があり、運用コストを抑えながら高性能を維持できる点が強みだ。特に推論処理の効率が上がれば、AIアプリケーションの応答速度やスケール能力が向上し、商用サービスの品質改善につながると考えられる。

また、データセンターの刷新需要が再び加速する可能性もある。

一方で、MoE採用の拡大はモデルの解釈性や安全性に新たな課題をもたらすかもしれない。

エキスパートの数が増えるほど挙動の全体像を把握しづらくなり、企業は検証体制の強化を迫られるだろう。故に、性能向上とガバナンス強化の両立が今後の焦点になると言える。

とはいえ、性能10倍というインパクトがAI市場全体の成長を促す面は大きく、クラウド事業者・アプリ開発企業ともに恩恵を受けられるだろう。

関連記事:

トランプ政権、エヌビディアAI先端半導体の対中販売許可を検討 安全保障が焦点か