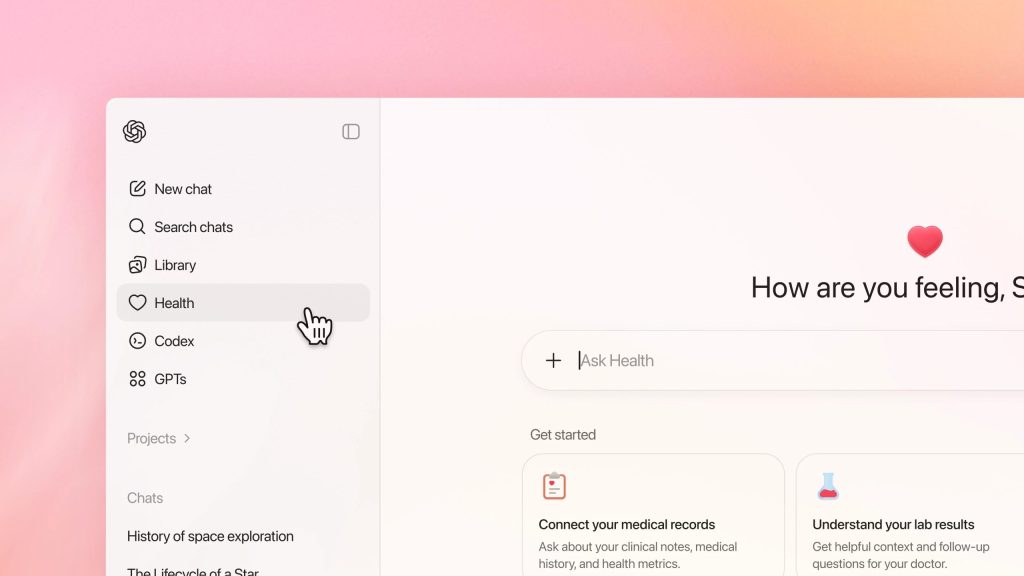

日本政府、AI開発における「人種・信条」情報の取り扱いを変更検討へ

2025年2月22日、日本政府は、人工知能(AI)の開発において、人種や信条といった「要配慮個人情報」の取得に関する同意を不要とする方針を検討していると発表した。

本件は、AI技術の進展に伴い、データ利活用を促進するための方針で、個人情報保護法の見直しに関連するものである。

AI学習における「要配慮個人情報」の本人同意を不要へ

現行の個人情報保護法(※)では、人種や信条、社会的身分、病歴、犯罪歴などの「要配慮個人情報(※)」を扱う際には、原則として本人の同意が必要である。

しかし、AIの学習には膨大なデータが必要であり、特に統計作成やAI開発においては、これらの情報を利用することが求められている。

そこで、政府の個人情報保護委員会は、AIの学習データとしてこれらの情報を使用する場合、同意を不要にする方向で検討を進めている。

具体的には、『AIの学習データや分析結果の獲得と利用のみを目的とする場合、個人の同意を不要とする』ことが提案されている。これにより、AI事業者はより自由にデータを活用できるようになるだろう。

政府は、要配慮個人情報の要件緩和や課徴金制度を盛り込んだ法改正案を、早ければ今国会に提出することを目指しているが、具体的な日程は未定だ。

業界の反応と今後の展望

自民党の一部や経済界からは、「企業が萎縮し自由な経済活動が阻害される」との懸念が示されている。特に、個人情報保護法の違反行為に対する課徴金の導入については、慎重な意見が多い。

今回の方針が法改正に至った場合、短期的にはAI開発のスピードが加速し、企業の研究開発コストが削減される可能性がある。しかし、国民の理解や受容が得られなければ、法改正そのものが社会的反発を招くことも考えられる。特に、欧州のGDPR(一般データ保護規則)のように厳格なプライバシー保護を求める潮流がある中で、日本の規制緩和は国際的な評価にも影響を及ぼすかもしれない。

中長期的には、データ利活用の枠組みをどう整備するかが鍵となる。

たとえば、第三者機関による監視強化や、AI開発に関する倫理指針の明確化が求められるだろう。また、国民が自身のデータの扱いを把握し、コントロールできる仕組みを構築することが、信頼を維持する上で不可欠になる。

これらの課題を放置すれば、規制のさらなる強化や社会的な反発によって、かえってAI産業の成長を停滞させる可能性もある。

政府や事業者は、透明性の確保と適切なガバナンスを両立させる道を模索する必要があるだろう。

※個人情報保護法:個人のプライバシーを守るために制定された法律。特に「要配慮個人情報」に関しては厳格な規制が設けられている。

※要配慮個人情報:人種、信条、社会的身分、病歴、犯罪の経歴、犯罪被害に関する情報などを指す。