OpenAI、音楽生成ツールを開発中 テキストと音声入力で作曲支援へ

2025年10月24日、米メディア「The Information」は、OpenAIがテキストや音声プロンプトを基に音楽を生成する新ツールを開発中であると報じた。

動画やボーカルトラックに音楽を付加する用途が想定され、ジュリアード音楽院の学生が学習データ作成に協力しているという。

OpenAI、テキストと音声から音楽を生成する新ツールを開発中

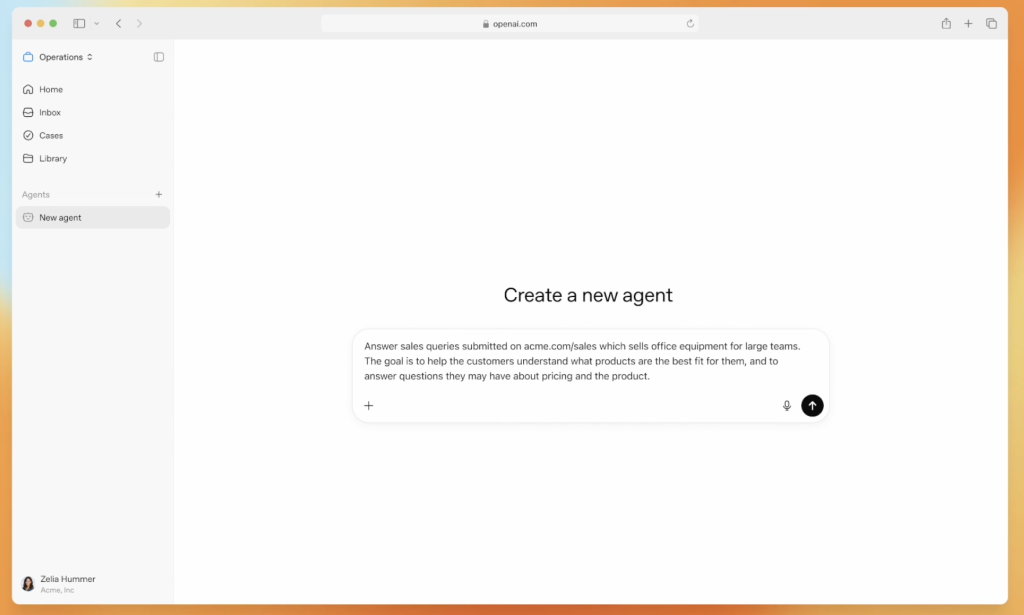

「The Information」の報道によると、OpenAIはテキストおよび音声入力に基づき楽曲を生成する新しい生成AIツールの開発を進めているという。

このツールは、動画へのBGM付与やボーカルトラックへのギター伴奏追加など、多様な用途に応用できる可能性がある。

現時点ではリリース時期は明らかにされておらず、ChatGPTや映像生成モデル「Sora」へ統合する形をとるのか独立した製品として提供されるのかも不明である。

関係筋によれば、OpenAIはジュリアード音楽院の学生と協力し、楽譜へのアノテーション(※)作業を通じて学習データの整備を進めているという。

これは、AIに対し楽曲構造や演奏意図を理解させるための基盤づくりとみられる。

同社は過去にも音楽生成モデルを試験的に開発していたが、それらはChatGPT登場以前のものであり、近年は主に音声合成(text-to-speech)や音声認識(speech-to-text)に注力してきた。

今回の動きは、音声技術の延長線上に音楽生成を再び位置づけ直す試みとも言える。

現在、生成音楽領域ではGoogleやSunoなど複数の企業がモデル開発を進めており、AIによる音楽創作の競争が激化している。

※アノテーション:AI学習用にデータへ意味情報(メロディ・リズム・和音など)を付与する作業。

音楽制作の民主化進む一方、著作権リスクも浮上

AIによる音楽生成技術の発展は、創作のハードルを大きく下げる。

テキストで「映画風のピアノ曲」「ボーカル付きポップス」などと指示するだけで、誰でも高品質な音源を作り出せるようになれば、動画制作や広告、個人クリエイターによる配信などで広く活用されるだろう。

特にプロンプトで感情や場面を指定できる仕組みが実装されれば、映像と音楽の統合的な生成が加速する可能性がある。

一方で、既存楽曲や演奏スタイルの模倣をめぐる著作権問題も避けられない。

生成過程で学習データとして使用された作品の権利関係が不透明な場合、アーティストやレーベルからの訴訟リスクが生じる恐れがある。

米国ではすでにAI生成音楽をめぐる訴訟が複数進行しており、法的整備は追いついていない。

報道通りであれば、OpenAIは音楽教育機関と連携することで、データ作成から透明性を確保しようとしているとみられる。

しかし、モデル公開後の利用範囲や商用制限など、ガイドライン策定が求められる段階にある。AIによる音楽生成が普及すれば、「誰が創作したのか」という問いの再定義が迫られることになるだろう。

関連記事:

グーグルが音楽生成AI「リリア」を発表 動画・画像・音声と統合可能な新時代の創作支援ツール