オープンAI、営利企業化を断念 公益重視の体制を維持へ

2025年5月5日、米国の人工知能(AI)開発企業オープンAIが、営利企業への転換を断念すると発表した。この決定は、AI開発における安全性と公益性を優先する姿勢を改めて強調するものであり、世界のAI産業にも影響を与える可能性がある。

安全性か、資本効率か 営利化断念の背景にあるAI倫理への揺らぎ

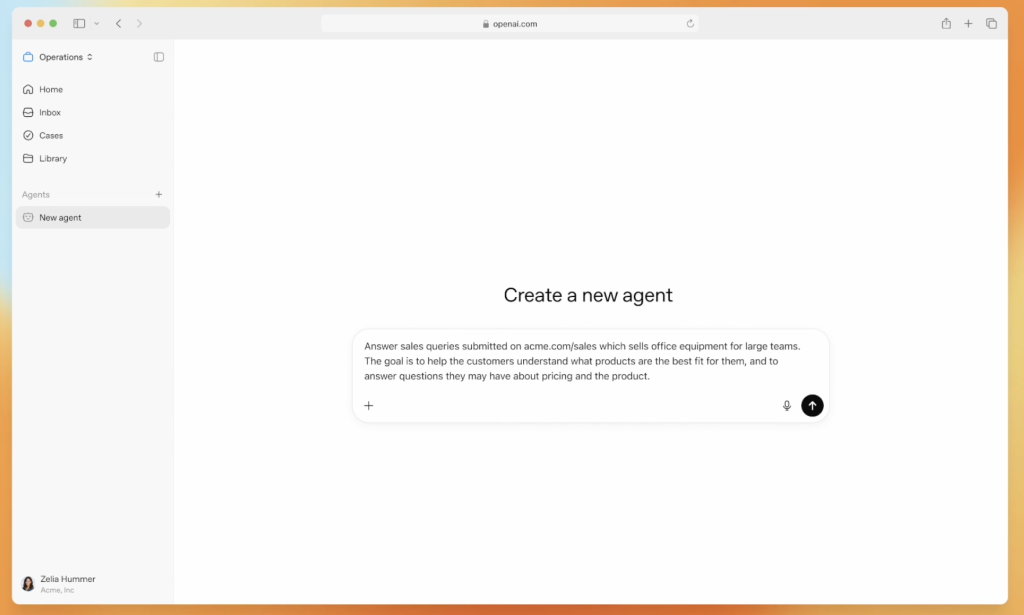

オープンAIは2015年の設立当初から、「人類全体の利益となる安全なAIの開発」を掲げてきた。近年、対話型AI「ChatGPT」の爆発的な普及を受けて、資金調達の必要性が急激に高まり、2024年12月には営利企業主導の運営体制に移行する計画を進めていた。

しかし、この方針はAI業界内外からの反発を招いた。

創業者の一人であるイーロン・マスク氏や、AI倫理の第一人者ジェフリー・ヒントン氏も営利企業化への転換に警鐘を鳴らしていた。これらの指摘を受け、オープンAIは非営利組織が営利子会社を監督する現在のハイブリッド構造を維持する方針に回帰した。

CEOのサム・アルトマン氏は声明で「この体制の見直しにより、迅速かつ安全にAIを進化させ、すべての人の手に優れたAIを届けられるようになると信じている」と述べた。

AIの発展には安全性と透明性が不可欠であり、成長スピードを優先する営利化路線では倫理的・社会的懸念を拭いきれなかったといえる。

資金調達と公益性の両立が今後の鍵に AI業界全体への影響は必至

オープンAIは2025年3月、AI向けの大規模データセンター構築を目的として、ソフトバンクグループなどから最大400億ドルの資金調達を発表している。しかし、その条件には営利企業への転換が含まれており、今回の決定によって資金の一部が減額される見込みだ。

これは、AI研究の進捗に少なからず影響を与えるだろう。

今後、同社は公益重視の立場を貫きながらも、いかにして巨額の開発資金を確保し続けるかという課題に直面するだろう。

資本と倫理の両立は容易ではないが、同様のジレンマは他のAI企業にも波及していくと考えられる。特に、技術の民主化や透明性が重視されるなかで、オープンAIの選択は一つの「ロールモデル」として注目されるだろう。

生成AIの信頼性や公平性をめぐる議論が深まる中では、営利性に傾きすぎない開発体制は、利用者や規制当局からの信頼構築にも資する。短期的には資金面でのリスクが生じるものの、中長期的には「社会的信用を得る」というメリットが勝る可能性もある。

したがって、長期的な視点で今後の動向を見ることが必要そうだ。