総務省がAIセキュリティー指針案を提示 特化型AI時代の漏洩対策を強化

2025年11月21日、総務省は国の検討会でAIセキュリティーに関する指針案を取りまとめた。生成AIの普及で機密情報の漏洩リスクが高まる中、開発企業に対策の常時更新を求める内容で、日本のAI実装を安全に進める動きが加速している。

AI企業に情報漏洩対策の常時強化を求める指針案

総務省の指針案は、生成人工知能(AI)の開発企業やサービス事業者に対し、情報漏洩リスクへの対応を不断に見直す必要があると示した点に特徴がある。AIが学習した企業秘密や未公開データを狙うサイバー攻撃が増えるなか、「脅威を完全に排除することは困難」と明記し、継続的な対策強化を前提とした。

指針案では、AIに安全基準を学習させ、不正指示の判定や回答の検証を行う仕組みを整備することが求められる。これにより、出力内容に機微情報が混入するリスクを低減することが狙いである。また、悪意あるデータをAIに学習させて非公開情報を引き出す攻撃や、意図的に負荷を与えてシステム障害を引き起こす手法にも注意を促した。

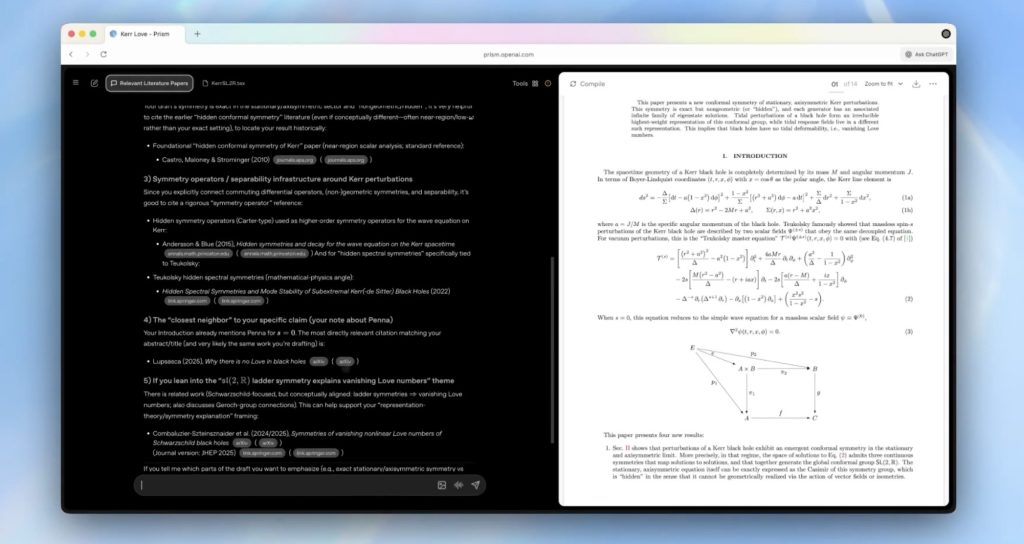

これまで主流だった汎用AIの利用では、個人情報や企業秘密を入力しない運用でリスク回避を図ってきた。しかし、今後は企業独自の知見を学習した特化型AIの活用が広がり、従来以上に漏洩リスクが高まると考えられる。政府がAIを重点政策とする方針を打ち出すなか、セキュリティー基盤の整備は避けて通れない段階に入ったと言える。

特化型AI普及で企業負担も増大 安全設計が競争力左右へ

特化型AIの普及が進むことで、企業は高度な機密情報を扱うAIを安全に運用する体制を求められる可能性が高まる。

指針案に沿って安全設計を行えば、安心してAI活用を拡大でき、生産性向上や新たな事業創出につながる余地がある。

特に製造、金融、医療など専門性の高い領域では、特化型AIの性能が競争力に影響を与える要素となる可能性がある。

一方で、不正指示の検知や回答内容の精査を行う仕組みを整えるには、技術投資や運用コストが伴う。脅威の進化に対応するためには、常時アップデートが望ましく、中小企業にとって負担が増す可能性が指摘されている。

また、特化型AIによる情報漏洩は事業への影響が大きく、リスク管理の難易度は以前より高まると考えられる。

政府がAIを17の戦略分野の筆頭に位置付けたことを踏まえると、安全性を前提としたAI導入の流れは今後も継続する可能性がある。

指針案は企業にとって追加負担であると同時に、信頼性の高いAI活用を進めるための土台とも言える。

特化型AIが経済成長に寄与する中、セキュリティー対策の重要性が企業の競争力に影響を与える時代が増すと考えられる。

関連記事:

総務省、生成AI信頼性の評価基盤を開発 来年度に企業試行へ

総務省、詐欺対策でAI活用を要請 通信大手に検知精度の高度化と制度支援を促す