ガートナー、日本企業のAIリスク対策を提言 実践を促す3つの取り組み

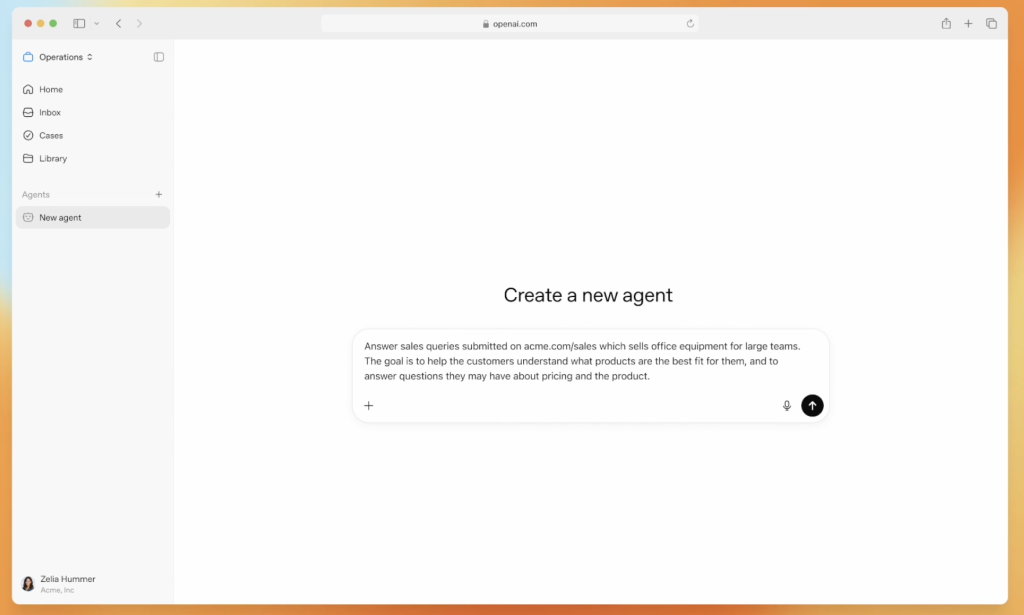

2025年3月18日、ガートナージャパンは日本企業向けにAIリスク対策の提言を発表した。同提言では、「AIガバナンスの確立」「一般従業員向けのリスクマネジメント」「開発・運用者向けのリスクマネジメント」という3つの主要な取り組みが示された。日本企業はこれらを実践し、競争力を維持しながらリスクを軽減することが求められる。

ガートナー提言の内容

今回の提言では、まず「AIガバナンスの確立」が重要視されている。企業がAIを適切に運用するためには、倫理的・法的・社会的基準に則った管理体制を構築する必要がある。これには、AI利用の指針策定や責任の明確化が含まれ、ガートナーはこうしたガバナンスの枠組みが企業の信頼性向上に繋がることを強調している。

次に、「一般従業員向けのリスクマネジメント」の強化だ。多くの企業では、従業員がAIを活用する機会が増えており、適切な利用方法を教育することが求められる。例えば、生成AI使用時のデータ流出リスクや、AI判断に過信して誤った意思決定を防ぐための研修が挙げられる。

さらに、「開発・運用者向けのリスクマネジメント」への対応も重要なポイントとなる。AIモデル開発時には、バイアス除去や透明性確保、セキュリティリスクの管理が必須だ。特に、生成AIや自動意思決定システムの導入が進む中、適切な対策を怠ると法的責任が問われるケースが増えると予測する。

これらのガートナーの提言を実施することは、単なる法的義務を超えて、企業の競争力を支える重要な要素である。3つの取り組みは、順次進めるべきだが、実際には最も緊急性の高い「一般従業員向けのリスクマネジメント」から着手する企業が多いという。

日本企業の対応と今後の展望

日本国内でも、すでにAIリスク対策を進めている企業が存在する一方で、対応が遅れる企業も少なくない。特に中小企業では、AIリスク管理のための人材や予算の確保が課題となる。こうした企業向けには、政府や業界団体による支援策の整備が求められるだろう。

国際的に見ると、EUではAI規制法(AI Act ※)の制定が進んでおり、米国でもガイドラインの策定が活発化している。実際、欧米企業ではAIの安全な利用に関する社内トレーニングの導入が加速している。

これに対して、日本はまだ明確な法規制を設けておらず、今後の対応が問われる状況だ。AIは業務の効率化や新たなビジネスモデルの創出に貢献する一方で、データの誤用、不正利用、倫理的な問題などの課題を引き起こす可能性がある。

AIの進化は止まらない。企業は競争力を維持するために、リスクを適切に管理しながらAIの活用を進める必要がある。ガートナーの提言は、今後のAI活用時代に向けて日本企業が競争優位を築くための道標となるだろう。

※AI規制法:欧州連合(EU)が策定したAIに関する法的枠組み。AIのリスクレベルを分類し、高リスクAIには厳格な規制を適用することを目的としている。2024年に合意され、2025年以降に段階的に施行される予定。